Page 21 - bilgem-teknoloji-dergisi-9

P. 21

Yapay Zekâ

BERT cümleler arası ilişkiyi anlamak için de sonraki ağından oluşmaktadır. Üretici model sentetik veriyi kulla-

cümle tahmini yapar; iki cümle varsa sonraki cümlenin narak sahte çıktılar üretirken ayrıştırıcı model üretici mo-

ilk cümlenin sonraki cümlesi olup olamaz mı onu tah- delin ürettiği çıktıların sahte olup olmadığını anlamaya

min etmeye çalışır. BERT’ in bu eğitim stratejisi diğer dil çalışır. Üretici model kendini ayrıştırıcı modeli kandıracak

modellerine oranla neden daha başarılı olduğunu anla- şekilde eğitir. Aynı zamanda ayrıştırıcı model kendisine

mamızı sağlıyor. gelen verinin gerçek mi sahte mi olduğunu anlamaya

çalışır. Böylelikle çekişmeli olarak birbirini eğiten iki mo-

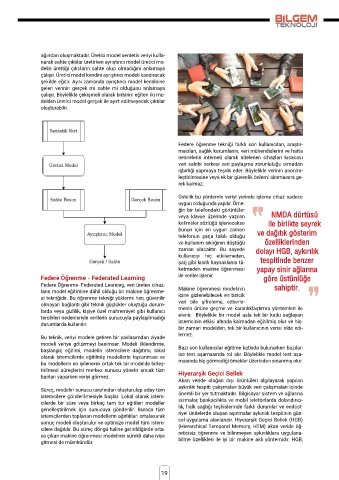

Üretken Ayrıştırıcı Ağlar - Generative delden üretici model gerçek ile ayırt edilmeyecek çıktılar

Adversarial Networks (GAN) oluşturabilir.

and now i am tired of my own

let me be the freshening blue

haunted through the sky bare

and cold water

warm blue air shimmering Federe öğrenme tekniği farklı son kullanıcıları, araştır-

brightly never arrive macıları, sağlık kurumlarını, veri mühendislerini ve hatta

sit seems to say nesnelerin interneti olarak nitelenen cihazları kısacası

veri sahibi herkesi veri paylaşma zorunluluğu olmadan

işbirliği yapmaya teşvik eder. Böylelikle verinin anonim-

Yukarıdaki şiirin kimin tarafından yazıldığını biliyor mu- leştirilmesine veya ek bir güvenlik önlemi alınmasına ge-

sunuz? Eğer 2018 yılında Bei Liu ve ekibi tarafından ya- rek kalmaz.

yınlanmış makaleyi okumadıysanız bilememeniz normal

Ernie: Hey ELMo, “ağaç” kelimesinin vektörünü söyler misin? çünkü bu şiir bir insan tarafından değil üretici bir makine Üstelik bu yöntemle veriyi yerinde işleme cihaz sadece

ELMo: “Bir sürü olasılık var. Cümle içinde kullanır mısın? “ öğrenmesi modeli tarafından yazıldı. uygun olduğunda yapılır. Örne-

Ernie: “Karşıdaki ağaç bana çocukluğumu hatırlattı.” ğin bir telefondaki görüntüler

ELMo: “ Bu durumda vektör: -0.01, -0.16, 0.12 …” Üretken Ayrıştırıcı Ağlar -Generative Adversarial veya klavye üzerinde yazılan NMDA dürtüsü

Networks (GAN) modelleri sentetik verileri kullanarak, kelimeler sözlüğü işlenecekse ile birlikte seyrek

Doğal dil işlemenin dönüm noktası olarak kabul edilen öğrendiği modellere uygun, benzer çıktılar üretir. Bu çıktı- bunun için en uygun zaman

BERT Google Yapay Zekâ ekibi tarafından paylaşılan bir lar resimler, sesler gibi değişik veri tiplerinde olabilir. GAN telefonun şarja takılı olduğu ve dağıtık gösterim

dil modelidir, farklı bir mimari değildir, (transformer en- 2014 yılında Ian Goodfellow ve arkadaşları tarafından ve kullanım sıklığının düştüğü özelliklerinden

coder’ını kullanır) bir eğitim stratejisidir. Bu eğitim stra- yayınlanmıştır. Yapay zekâ alanında çığır açan bu mo- zaman olacaktır. Bu sayede dolayı HGB, aykırılık

tejisi ile Google diğer dil modellerini geride bırakıp daha del, Facebook yapay zekâ araştırmaları direktörü Yann kullanıcıyı hiç etkilemeden,

başarılı sonuçlar elde etmiştir. Peki, nedir bu BERT’in ba- LeCun tarafından “Makine öğrenmesi alanında son 10 şarj gibi kısıtlı kaynaklarını tü- tespitinde benzer

şarısının sırrı? ELMo iki yönlü LSTM kullanarak soldan yılda ortaya çıkan en ilginç fikir.” olarak nitelendirilmiştir. ketmeden makine öğrenmesi yapay sinir ağlarına

sağa ve sağdan sola elde edilen bilgileri ayrı ayrı elde Federe Öğrenme - Federated Learning ile veriler işlenir. göre üstünlüğe

edip kullanırken (tek yönlü), BERT kelimenin hem sağın- Aşağıdaki resimde Karras ve arkadaşlarının 2018 yılında

dan hem de solundan aynı anda bakarak kullanır (çift yaptığı çalışmanın sonuçlarını görmektesiniz. Bu çalış- Federe Öğrenme- Federated Learning, veri üreten cihaz- Makine öğrenmesi modelinin sahiptir.

ların model eğitimine dâhil olduğu bir makine öğrenme-

yönlü). BERT ve Ernie arasında geçen diyalog ile BERT mada GAN modeli ünlü kişiliklerin fotoğrafları ile eğitil- içine gizlenebilecek en biricik

eğitim stratejisini anlamaya çalışalım; miş ve sonuç olarak gerçek insanlardan ayırt edilemeye- si tekniğidir. Bu öğrenme tekniği yükleme hızı, güvenilir veri bile şifreleme, ezberle-

cek sahte insan resimleri ortaya çıkmıştır. olmayan bağlantı gibi teknik güçlükler oluştuğu durum- menin önüne geçme ve karanlıklaştırma yöntemleri ile

BERT: “Biz transformer encoder’larını çift yönlü kullanıyoruz.” larda veya gizlilik, kişiye özel mahremiyet gibi kullanıcı elenir. Böylelikle bir model asla tek bir katkı sağlayan

tercihleri nedenleriyle verilerin sunucuyla paylaşılmadığı

Ernie: “Bu delilik! Herkes, bu şekilde kelimelerin kendile- Bir GAN modeli temel olarak, üretici (generator) ve ay- istemcinin etkisi altında kalmadan eğitilmiş olur ve hiç-

rini göreceğini bilir.” rıştırıcı (discriminator) olarak adlandırılan iki yapay sinir durumlarda kullanılır. bir zaman modelden, tek bir kullanıcının verisi elde edi-

BERT: “Maskeleri kullanıyoruz.” lemez.

Bu teknik, veriyi modele getiren bir yaklaşımdan ziyade

modeli veriye götürmeyi benimser. Modeli ilklendirme,

Diyaloğa göre BERT’in çift yönlü kelimenin bulunduğu Bazı son kullanıcılar eğitime katkıda bulunurken bazıları

cümleyi taramasının getirdiği problemi Ernie açıkça başlangıç eğitimi, modelin istemcilere dağıtımı, lokal ise test aşamasında rol alır. Böylelikle model test aşa-

olarak istemcilerde eğitilmiş modellerin toplanması ve

belirtmiş ve BERT buna çözüm olarak maskeleri kullan- masında hiç görmediği örnekler üzerinden sınanmış olur.

dıklarını belirtmiştir. Peki, nedir bu maskeler ve nerede bu modellerin en iyilenerek ortak tek bir modelde birleş-

tirilmesi süreçlerini merkez sunucu yönetir ancak tüm

kullanılırlar? BERT eğitim yaparken cümledeki kelime- bunları yaparken veriyi görmez. Hiyerarşik Geçici Bellek

lerin %15’ini maskeleyerek bu kelimeleri tahmin etmeye Akan veride olağan dışı örüntüleri algılayarak yapılan

çalışır. Eğer bu maskeleme oranı %15’den fazla olursa Süreç, modelin sunucu tarafından oluşturulup aday tüm aykırılık tespiti çalışmaları büyük veri çalışmaları içinde

eğitim için yeterli içerik olmaz, az olursa eğitim maliyeti istemcilere gönderilmesiyle başlar. Lokal olarak istem- önemli bir yer tutmaktadır. Bilgisayar sistem ve ağlarına

artar. Diyalog devam eder; sızmalar, bankacılıkta ve mobil telefonlarda dolandırıcı-

cilerde bir süre veya birkaç tam tur eğitilen modeller

genelleştirilmek için sunucuya gönderilir. Burada tüm lık, halk sağlığı teşhislerinde farklı durumlar ve endüst-

Ernie: “ O zaman maskelenmiş kelime hiç görülmez.” istemcilerden toplanan modellerin ağırlıkları ortalanarak riyel ünitelerde oluşan aşınmalar aykırılık tespitinin gün-

BERT: “Maskelenen kelimeler zamanın tamamında mas- sonuç modeli oluşturulur ve optimize model tüm istem- cel uygulama alanlarıdır. Hiyerarşik Geçici Bellek (HGB)

kelenmiş olmazlar; zamanın %80’ninde maskelidirler, cilere dağıtılır. Bu süreç döngü haline getirildiğinde orta- (Hierarchical Temporal Memory, HTM) akan veride öğ-

%10’nunda yerlerine başka bir kelime gelir ve geri kalan ya çıkan makine öğrenmesi modelinin sürekli daha iyiye reticisiz öğrenme ve bilinmeyen aykırılıklara uygulana-

%10’da ise değiştirilmeden kalırlar.” bilme özellikleri ile iyi bir makine aklı yöntemidir. HGB,

gitmesi de mümkündür.

18 19